先将目前已有的模型列出:

| 模型名称 | 参数 | 地址 | 效果 |

|---|---|---|---|

| BiRefNet-DIS_ep580.pth | 849MB | BiRefNet-DIS_ep580.pth · ViperYX/BiRefNet at main | (旧模型) |

| BiRefNet-ep480.pth | 849MB | ViperYX/BiRefNet at main | (旧模型) |

| COD.safetensors | 844MB | https://huggingface.co/ZhengPeng7/BiRefNet-COD/ | 用于高分辨率二分图像分割的双侧参照物 |

| DIS-TR TEs.safetensors | 844MB | lldacing/ComfyUI_BiRefNet_ll | 基于大量数据集训练的 DIS 任务模型,可能在二值图像分割任务上具有更优的性能。 |

| DIS.safetensors | 844MB | lldacing/ComfyUI_BiRefNet_ll | 用于二值图像分割(DIS)任务的模型文件,适用于需要将图像分割为目标和背景两类的场景。 |

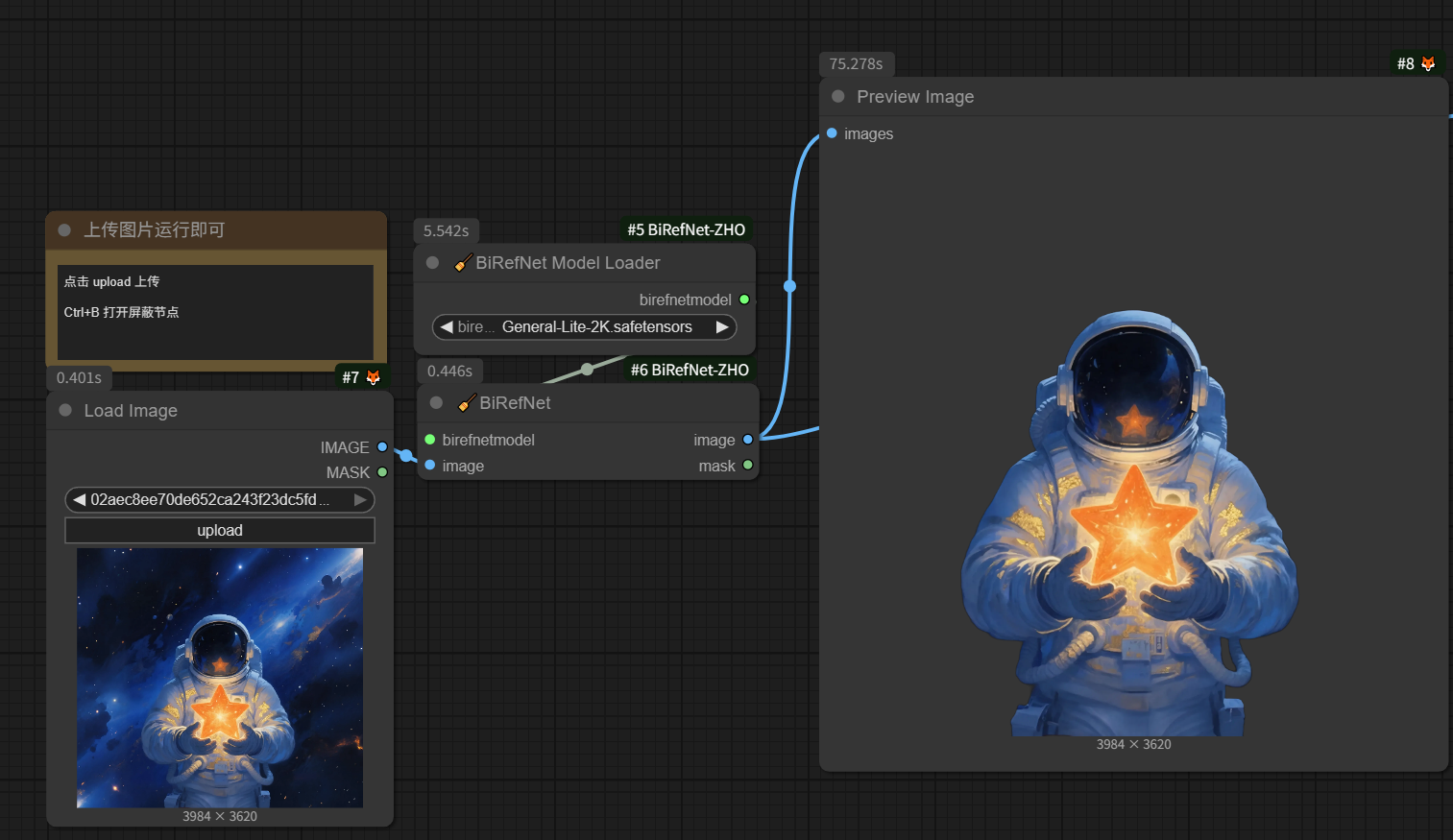

| General-Lite-2K.safetensors | 169MB | dimitribarbot/sd-webui-birefnet: BiRefNet for AUTOMATIC1111 Stable Diffusion WebUI | 轻量级的通用模型,适用于 2560x1440 等高分辨率场景,兼顾性能与计算效率。 |

| General-Lite.safetensors | 169MB | dimitribarbot/sd-webui-birefnet: BiRefNet for AUTOMATIC1111 Stable Diffusion WebUI | 轻量级的通用模型,适用于一般场景的背景移除等任务,计算资源消耗较低。 |

| General.safetensors | 424MB | dimitribarbot/sd-webui-birefnet: BiRefNet for AUTOMATIC1111 Stable Diffusion WebUI | 通用模型,适用于各类一般的背景移除、目标分割等场景,是基础的通用型模型。 |

| HRSOD.safetensors | 844MB | dimitribarbot/sd-webui-birefnet: BiRefNet for AUTOMATIC1111 Stable Diffusion WebUI | 用于 HRSOD(high-resolution salient object detection,高分辨率显著目标检测)任务,擅长检测高分辨率图像中的显著目标。 |

| Matting.safetensors | 844MB | dimitribarbot/sd-webui-birefnet: BiRefNet for AUTOMATIC1111 Stable Diffusion WebUI | 通用无 trimap 抠图任务的模型文件,专门针对图像抠图场景设计,能够实现对图像中目标的精细抠取,适用于需要获取高质量前景与背景分离效果的场景 |

| Portrait.safetensors | 844MB | dimitribarbot/sd-webui-birefnet: BiRefNet for AUTOMATIC1111 Stable Diffusion WebUI | 专门针对人像场景的模型,在人像分割、背景移除等任务上表现出色。 |

| RMBG-2.0/model.safetensors | dimitribarbot/sd-webui-birefnet: BiRefNet for AUTOMATIC1111 Stable Diffusion WebUI | 从名称看 RMBG-2.0 相关的背景移除模型文件,但该模型并非 sd-webui-birefnet 仓库中 BiRefNet 系列的核心模型,用于特定的背景移除场景,具体用途需结合其训练任务判断。 | |

| RMBG-2.0/pytorch model.bin | 885MB | briaai/RMBG-2.0 at main | RMBG-2.0 模型的 PyTorch 权重文件,与同目录下的 model.safetensors 功能类似,均为背景移除相关模型权重,可能用于不同的加载方式或版本兼容。 |

| pth/BiRefNet-general-epoch 244.pth | dimitribarbot/sd-webui-birefnet: BiRefNet for AUTOMATIC1111 Stable Diffusion WebUI | 适用于一般的背景移除等通用场景,是训练过程中特定阶段的权重快照。 | |

| pth/BiRefNet HR-general-epoch 130.pth | dimitribarbot/sd-webui-birefnet: BiRefNet for AUTOMATIC1111 Stable Diffusion WebUI | BiRefNet 高分辨率通用模型训练到 130 个 epoch 的文件,适用于高分辨率图像的通用场景任务,在高分辨率图像处理上有较好表现。 | |

| pth/BiRefNet HR-matting-epoch 135.pth | 444MB | ZhengPeng7/BiRefNet_HR-matting at main | ZhengPeng7/BiRefNet_HR-matting · Hugging Face这是 BiRefNet 的高分辨率抠图模型(HR-matting),训练到了 135 个 epoch,适用于需要高分辨率图像抠图的场景。 |

| pvt_v2_b2.pth | 102MB | ViperYX/BiRefNet at main | 骨干网络(backbone)使用,为模型提供特征提取能力 |

| pvt_v2_b5.pth | 328MB | ViperYX/BiRefNet at main | 相较于 b2 版本,可能具有更深的网络结构或更多的参数,能提取更丰富的图像特征,同样可能作为 BiRefNet 的骨干网络 |

| swin base patch4 window12 384 22kto1k.pth | 365MB | ViperYX/BiRefNet at main | 这是 Swin Transformer 的 base 版本模型文件,“patch4 window12 384” 表示其相关配置(patch 大小为 4、窗口大小为 12、输入图像尺寸为 384),“22kto1k” 表示模型是在 22k 数据集上预训练后,又在 1k 数据集上微调得到的。该模型可能作为 BiRefNet 的骨干网络,用于特征提取。 |

| swin large patch4 window12 384 22kto1k.pth | 801MB | ViperYX/BiRefNet at main | large 版本模型文件,配置与 base 版本类似,但网络规模更大,参数更多,可能能提取更细致的特征,可作为 BiRefNet 的骨干网络使用。 |

算法介绍:

- 通用型(General):适用于一般场景的预训练模型。

- 通用型-高分辨率(General-HR):适用于一般场景的预训练模型,在更高分辨率图像(2048x2048)上表现出色。

- 通用型-轻量版(General-Lite):适用于一般场景的轻量级预训练模型。

- 通用型-轻量版-2K(General-Lite-2K):适用于高分辨率(2560x1440)一般场景的轻量级预训练模型。

- 通用型-动态分辨率(General-dynamic):适用于动态分辨率的预训练模型,训练图像分辨率范围为256x256至2304x2304。

- 通用型-512分辨率(General-reso_512):适用于更低分辨率的预训练模型,速度更快、精度更高,基于512x512图像训练。

- 通用型-旧版(General-legacy):适用于一般场景的预训练模型,训练数据集包括DIS5K-TR、DIS-TEs、DUTS-TR_TE、HRSOD-TR_TE、UHRSD-TR_TE、HRS10K-TR_TE(不含人像分割数据)。

- 人像(Portrait):用于人物肖像的预训练模型。

- 抠图(Matting):适用于一般无Trimap抠图场景的预训练模型。

- 抠图-高分辨率(Matting-HR):适用于一般抠图场景的预训练模型,在更高分辨率图像(2048x2048)上表现出出色的抠图性能。

- 抠图-轻量版(Matting-Lite):适用于一般无Trimap抠图场景的轻量级预训练模型。

- 二分图像分割(DIS):用于二分图像分割的预训练模型。

- 高分辨率显著目标检测(HRSOD):用于高分辨率显著目标检测的预训练模型。

- 隐蔽目标检测(COD):用于隐蔽目标检测的预训练模型。

- DIS-TR_TEs:基于大规模数据集训练的预训练模型。

目前常用模型:

models:

- ZhengPeng7/BiRefNet

- ZhengPeng7/BiRefNet-portrait 💡

ai、设计、本银河星区空间站,是由 Tia 打造,主要分享日志、ai、设计、效率工具和在银河系生活的所思所想,欢迎分享文章